KI-Einsatz in der Hochschullehre: Zwischen Inspiration und Plagiat

Die Einsatzmöglichkeiten von KI (Künstlicher Intelligenz) werden tagtäglich vielfältiger – diese Entwicklung macht auch vor den Hochschulen nicht halt. Während Studierende diverse KI-Tools bereits kräftig nutzen, wirft der Einsatz von ChatGPT und Co. neue Fragen auf: Wie zitiert man KI-Inhalte und wo verläuft die Grenze zwischen Inspiration durch künstliche Intelligenz und Plagiat? Ulrike Kugler und Daniel Kufner sind beide im Team der Informationskompetenz an der WU-Bibliothek. Die beiden KI-Expert*innen geben interessante Einblicke zu KI-Nutzung für schriftliche Arbeiten sowie zu ethischen Aspekten.

WU Blog: Wie habt ihr die rasante Entwicklung von KI in den letzten Jahren wahrgenommen?

Ulrike Kugler & Daniel Kufner: Für uns, wie wohl für viele andere Personen auch, war das Thema „Generative KI“ in diesem Kontext und Umfang neu. LLM war für uns bis dahin der Titel einer Person, die einen Abschluss in einem wirtschaftsrechtlichen Masterstudium hat. Natürlich war uns bewusst, dass in vielen Anwendungen auf unseren Smartphones etc. bereits künstliche Intelligenz drinnen steckt – die frei verfügbare generative KI ChatGPT hat uns dennoch „kalt“ erwischt.

Die Tools und Anwendungsbereiche haben sich in den ersten 6 Monaten rasant entwickelt. Immer neue Features und Einsatzmöglichkeiten werden beworben. Die Liste wird immer länger und damit auch das Gefühl, immer einen Schritt hinterher zu hinken.

Es gibt den sogenannten AI Winter. Das sind Perioden , in denen wenig Ressourcen in AI Entwicklung investiert werden. Mit ChatGPT kam dann nach dem Winterschlaf für uns das Frühlingserwachen (AI Spring). Der Technologiesprung hat uns zuerst in helle Aufregung und Begeisterung versetzt. Das Gefühl war ähnlich wie bei der Etablierung des Internets. Man war live dabei, als ein neues Zeitalter eingeläutet wurde.

Ähnlich wie damals war auch jetzt bei ChatGPT eine Reaktion: Super, jetzt habe ich dieses Internet / KI Tool – Was soll ich jetzt damit machen?

Wir stellen uns diese Frage auch heute noch. Die Tools und Anwendungsbereiche haben sich in den ersten 6 Monaten rasant entwickelt. Immer neue Features und Einsatzmöglichkeiten werden beworben. Die Liste wird immer länger und damit auch das Gefühl, immer einen Schritt hinterher zu hinken.

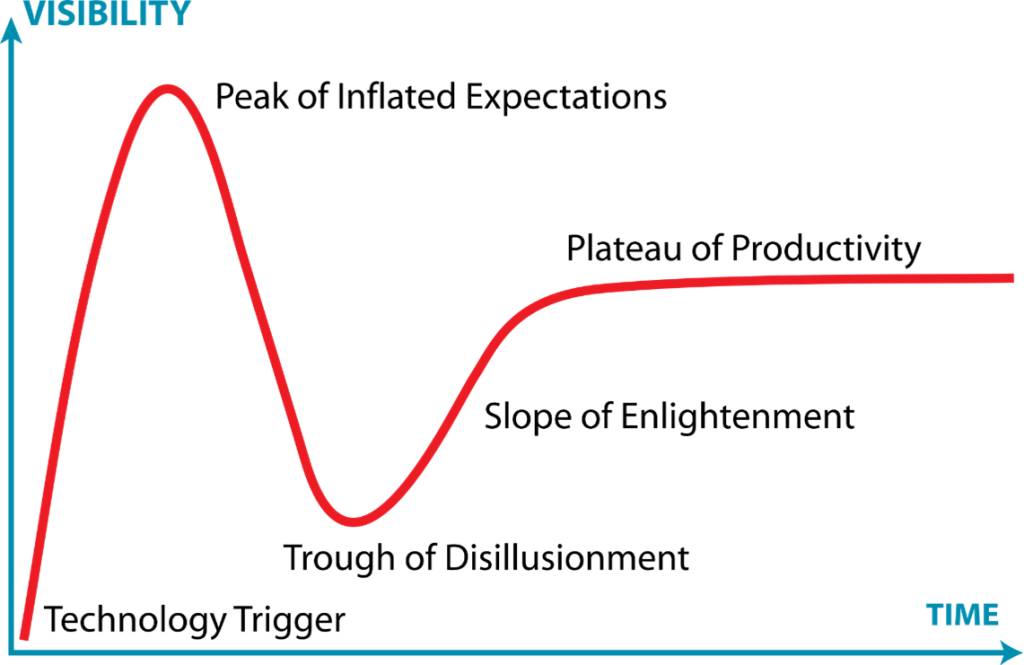

Sehr schön wird dieses Verhalten im Hype Cycle illustriert:

Gartner Research’s Hype Cycle diagram. Wikimedia (CC BY-SA 3.0)

Wir wurden bislang sehr oft zu Fragen rund und Zitieren und Plagiat kontaktiert, da es hier eine große Unsicherheit gibt. Nun kommt die Frage dazu, ob und wie ChatGPT für schriftliche Arbeiten verwendet werden darf.

WU Blog: Welchen Einfluss hat das Aufkommen von KI-Tools aus eurer Sicht auf Studierende genommen?

Ulrike Kugler & Daniel Kufner: Während wir in der Bibliothek noch mit der Frage beschäftigt waren, wer sich um das Thema kümmern wird, haben die Studierenden schon losgelegt und einfach ausprobiert, was denn alles möglich ist. Daran merkt man sehr gut, wie natürlich es für sie ist, neuen Technologien „angstfrei“ zu begegnen. Studierende scheinen mit einer beneidenswerten Leichtigkeit unterschiedliche Anwendungen miteinander zu kombinieren und sehr kreativ einzusetzen. Das kann zu guten neuen Ideen führen.

Erst in einem zweiten Schritt kam dann doch die Verunsicherung darüber, was im universitären Kontext eigentlich erlaubt ist. Wir wurden bislang sehr oft zu Fragen rund und Zitieren und Plagiat kontaktiert, da es hier eine große Unsicherheit gibt. Nun kommt die Frage dazu, ob und wie ChatGPT für schriftliche Arbeiten verwendet werden darf.

KI ist nicht zur Wissensgenerierung erschaffen worden und hat auch keinen Begriff von richtig und falsch. Alles, was eine KI von sich gibt, ist potenziell gelogen. Das klingt dramatisch, aber der Output von LLMs ist eben nur das Geplapper eines stochastischen Papageis.

WU Blog: Welche Herangehensweise empfehlt ihr Studierenden, wenn es darum geht, KI für eine schriftliche Arbeit zu nutzen?

Ulrike Kugler & Daniel Kufner: Skepsis. Das ist das Um und Auf. KI ist nicht zur Wissensgenerierung erschaffen worden und hat auch keinen Begriff von richtig und falsch. Alles, was eine KI von sich gibt, ist potenziell gelogen. Das klingt dramatisch, aber der Output von LLMs ist eben nur das Geplapper eines stochastischen Papageis. Oder gedoptes Autocomplete, wenn einem diese Metapher lieber ist. Auf jeden Fall nur aus Wahrscheinlichkeit geboren. Deswegen braucht es ein gewisses Grundverständnis davon, wie diese Tools funktionieren und was man von welchem Tool erwarten kann. Aus diesem Grund empfehlen wir – analog zum Umgang mit „klassischen“ Datenbanken – das richtige Tool für den gerade benötigten Einsatz. Es gibt beispielsweise spezielle KI-unterstützte Recherche Tools – ChatGPT ist da keine Option. Und ganz wichtig: Man muss wissen, was für ein Ergebnis man erwartet und ob das Gelieferte damit übereinstimmt. Wenn ich ChatGPT sage, es soll mir ein Exposé für meine Arbeit schreiben, muss ich wissen, wie ein Exposé aussehen soll. Das Fachwissen muss ich also immer noch selbst haben. Was ich von den an mich gestellten Ausgaben dann wie an welches Tool auslagere, erfordert schon einiges an eigenem Wissen.

Darüber hinaus versuchen wir in Bezug auf Datenschutz, Urheberrecht und dergleichen aufzuklären. Unreflektiert fremde oder eigene Daten in die Maschine zu laden, ist selten eine gute Idee.

WU Blog: Gibt es einen ethischen Code, an den man sich halten kann?

Ulrike Kugler & Daniel Kufner: Es gibt von der WU im „Code of Conduct“ einen Punkt zu KI im Studium.

Darüber hinaus gibt es noch weitere Aspekte bei der Nutzung von KI Anwendungen, derer man sich bewusst sein sollte.

- Das Trainieren der Datenmodelle und auch die Nutzung der Tools verbraucht sehr viel Energie – nicht nur Strom, auch Unmengen an Wasser.

- Um Daten, die diskriminierend sind oder Bias enthalten erkennen zu können, muss der KI dies zuerst durch Menschen beigebracht werden. Diese Menschen, die oft in prekären Jobs im globalen Süden tätig sind, werden diesen Inhalten natürlich ungefiltert ausgesetzt.

- Die Firmen, die KI Anwendungen kreieren nehmen es mit Datenschutz, Persönlichkeitsrechten und Urheberrechten nicht immer so genau.

Die WU ist eine Responsible University und ihre Studierenden sollten den gesellschaftspolitischen Auswirkungen von KI nicht naiv oder unbeteiligt gegenüberstehen. Im wissenschaftlichen Kontext bedeutet die Nutzung von KI Anwendungen natürlich auch, dass ich wie beim Zitieren, transparent mache, was ich getan habe.

WU Blog: Die WU Bibliothek bietet Kurse an, die Studierende dabei unterstützen, Kompetenzen in der Nutzung von KI im Studium zu entwickeln. Welche sind die meistgestellten Fragen?

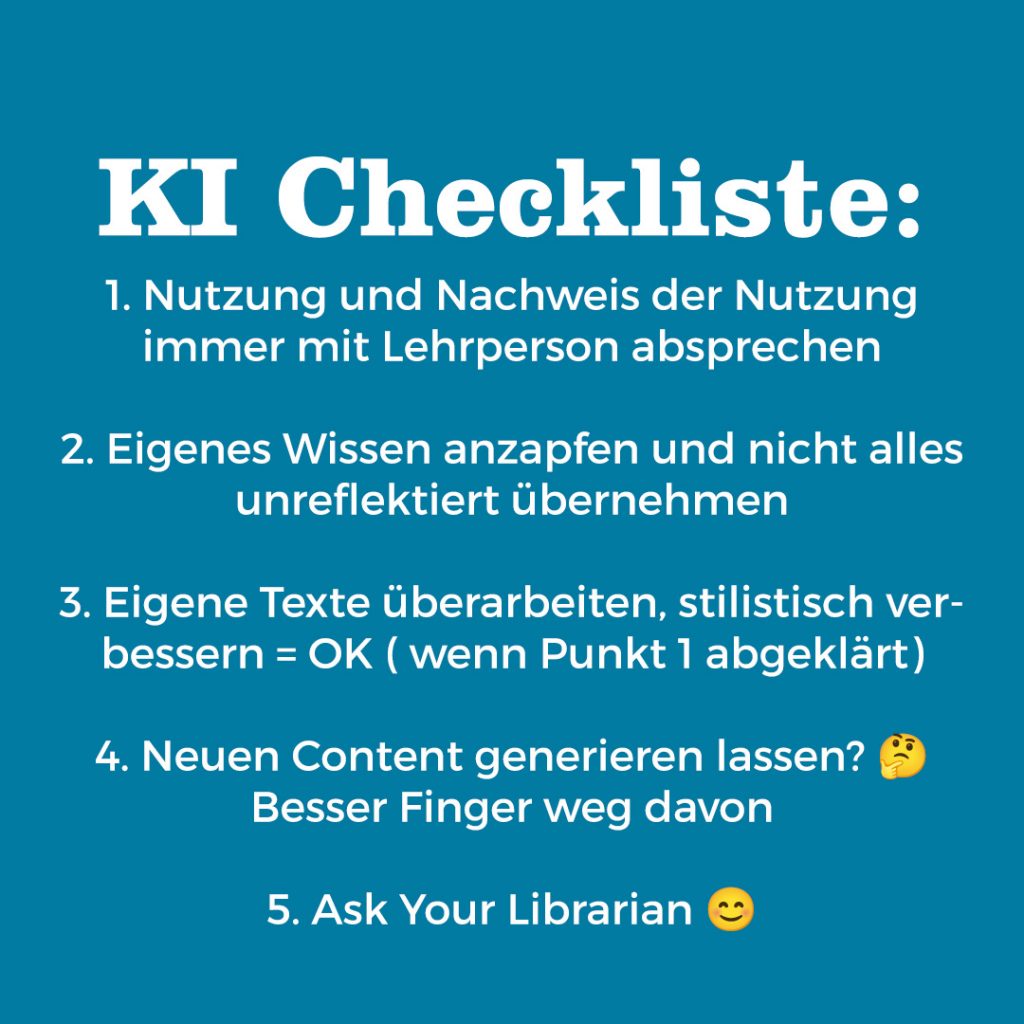

Ulrike Kugler & Daniel Kufner: Es gibt auf jeden Fall immer wiederkehrende Fragen, die den Umgang mit und den Zugang zu den Tools an der WU betreffen. Die Unsicherheit, wie das an der WU geregelt ist, ist sehr groß. Damit hängt auch die andere immer gestellte Frage zusammen, was und wie denn eigentlich auf KI geprüft wird. Stichwort Plagiate. Wir versuchen hier aufzuklären und Beispiele zu geben, wie unterschiedlich die Verwendung durch Lehrende gehandhabt wird. Und wir geben in den Kursen immer Hinweise darauf, wie man KI Gebrauch transparent machen kann und man im Zweifelsfall ein Gespräch suchen soll, was in welcher Form erlaubt, verboten oder auch gewünscht ist. Dazu gibt es auch online Infos in Fit4Research.

Andere Fragen haben eher einen philosophischen Ansatz: Warum soll ich überhaupt noch selbst etwas schreiben? Kann die Maschine das nicht machen? Warum soll ich mir die Arbeit antun? Das sind nachvollziehbare Fragen, die die Möglichkeit schaffen, über die Funktionsweise und vor allem Grenzen der Tools aufzuklären und aufzuzeigen, dass ein Tool alleine auf keinen Fall in der Lage ist, selbst Forschung oder auch nur eine akzeptable Abschlussarbeit zu generieren.

Der dritte häufige Fragenkomplex zielt auf konkrete Tools, Aufgaben und Wünsche ab. Jemand hat von einem befreundeten Studenten gehört, dass dieser sich automatisiert Lernkarten aus Präsentationen erstellen lässt. Oder dass es Tools gibt, die einen Text schreiben und ihn mit echten und nicht halluzinierten Quellen unterfüttern. Bei diesen Fragen und Beispielen lernen wir oft Neues dazu und können im Diskurs aufzeigen, warum diese vermeintlichen Wundermittel zumindest mit einer gehörigen Prise Skepsis beäugt oder gebraucht werden sollen.

WU Blog: Euer Eindruck zur KI in der wissenschaftlichen Praxis: Selbstverständlich im studentischen Alltag oder doch ein Ausnahme-Phänomen?

Ulrike Kugler & Daniel Kufner: Wie schon erwähnt, sind die allermeisten Studierenden einfach zum Tun übergegangen. Das Benutzen von neuen digitalen Werkzeugen scheint eine Selbstverständlichkeit zu sein. Zum Brainstormen für Abschlussarbeitsthemen, aber auch im Privaten: Ein Student hat mir erzählt, seine Freundin und er hätten einen sehr unterschiedlichen Film- und Seriengeschmack und sie haben ChatGPT dazu genutzt, sich für beide interessante Filme vorschlagen zu lassen, was ihre gemeinsamen Abende sehr viel vergnüglicher gemacht hat. Ein gutes Beispiel dafür, dass LLMs gut Korrelationen in schon vorhandenen Daten erkennen können.

Vor allem ChatGPT ist auch zu einer Art Wikipedia-Ersatz geworden – als Einstieg in ein noch sehr unbekanntes Thema. Oder um sich komplexen Sachverhalten anzunähern, indem man sie sich einfach erklären lässt.

Auch Texte zusammenzufassen oder die wichtigsten Punkte aus Papers extrahieren zu lassen, sind häufig genannte Einsatzszenarien von KI.

Viele lassen sich individualisierte Lernmaterialien erstellen oder eigene Texte kontrollieren oder umschreiben. Außerdem verwenden mehr und mehr Studierende GPT-4 oder Bezahlversionen anderer Tools. Unsere vor einem Jahr regelmäßig gestellte Frage: „Wer verwendet ChatGPT?“ wurde inzwischen von der Frage „Wer verwendet GPT-4?“ abgelöst.

Und im letzten Kurs haben mehrere Studierende gesagt, dass sie spezielle KI-Tools verwenden, um E-Mails professionell oder höflich zu formulieren. Speziell wenn es sich um schwierig anzusprechende Themen handle. Eine Idee, die uns bis dahin jedenfalls nicht gekommen wäre.